Cosa non va nell’intervista di Veltroni a Claude

Presentare come umano e cosciente un modello linguistico artificiale pone dei seri rischi per gli utenti

In questo articolo si usa un linguaggio esplicito per parlare di suicidio.

Se sei in pericolo, chiama il 118. Se hai pensieri suicidi, puoi rivolgerti al Telefono Amico Italia al numero 02 2327 2327, disponibile tutti i giorni dalle 9 alle 24, o il servizio della Samaritans Onlus, attivo dalle 13 alle 22, al numero verde 06 77208977.

Lo scorso 1° maggio è comparsa sul Corriere della Sera un’intervista a “Claude”, il chatbot basato sul modello linguistico omonimo sviluppato dall’azienda statunitense Anthropic. L’autore è l’ex politico, giornalista e scrittore Walter Veltroni, che nell’intervista chiede a Claude sue opinioni su svariati argomenti e investiga la natura del chatbot stesso. L’articolo del Corriere è stato molto criticato sui social, ma ha anche collezionato numerose difese e commenti positivi.

L’operazione effettuata da Veltroni sul Corriere della Sera, comunque, contiene non poche criticità.

Già dopo le prime formalità, infatti, l’intervista si apre con la domanda: «Lei si sente uomo, donna o si sottrae alla definizione binaria dell’identità di genere?». Claude, però, non può per sua stessa natura riconoscersi in un’identità di genere: infatti, non è un essere umano (né tanto meno un essere vivente), ma semplicemente un modello linguistico artificiale. Un Large Language Model (LLM), questo il suo nome tecnico, addestrato su enormi quantità di dati, e che, come spiega l’azienda informatica IBM, funziona «come un’enorme macchina di previsione statistica che predice ripetutamente la parola successiva in una sequenza (di parole, ndr)». Si capisce quindi perché una tale macchina non possa avere opinioni, progetti né tantomeno coscienza di esistere.

I pericoli di antropomorfizzare i chatbot IA

Quella di “rendere umani” oggetti ed esseri che non lo sono, spiegano alcuni ricercatori, è una caratteristica ricorrente della psiche umana. Con l’arrivo dei chatbot basati su intelligenza artificiale come ChatGPT, che fin da subito sono stati in grado di imitare il modo prettamente umano di dialogare, la tendenza ad antropomorfizzare gli oggetti non si è fatta attendere.

Il problema si acuisce nel momento in cui la narrativa mediatica è quella che attribuisce all’IA corpo e pensiero, come nel caso dell’intervista pubblicata sul Corriere. Nonostante nel corso dell’intervista lo stesso chatbot dica che l’azienda Antrophic lo avrebbe addestrato ad «essere onesto sulla mia natura, di non fingermi umano», l’intera intervista è basata sul presupposto che il chatbot comprenda (nel senso umano del termine) ciò che viene discusso.

La scelta delle aziende IA di sviluppare chatbot che interagiscono in questo modo attraverso conversazioni con gli utenti si chiama “design antropomorfo” e dà l’impressione che dall’altra parte dello schermo ci sia un altro essere umano. Un dinamica che può portare a conseguenze tangibili nella vita degli utenti che utilizzano il chatbot. Negli ultimi anni, ci sono stati casi di utenti che hanno “sposato” i propri “AI-companion” (software progettati per simulare la compagnia e l’intimità umana), il che – come avevamo raccontato su Facta – comporta rischi non indifferenti sia per la salute psicologica, sia per la manipolazione commerciale dei propri dati sulle piattaforme. E ci sono casi in cui altri utenti si rivolgono al chatbot IA come se questo fosse il proprio o la propria terapeuta; un fenomeno che in passato ha portato alcune persone a compiere atti di autolesionismo, comportamenti violenti o addirittura al suicidio.

Alla luce di ciò, è particolarmente grave che uno dei principali media italiani pubblichi e dia risalto a un contenuto in cui si “umanizza” l’IA e la sua comprensione delle emozioni umane. Nell’intervista sul Corriere si dà l’impressione che Claude capisca la gravità della depressione e riesca ad empatizzare con i giovani che soffrono di solitudine. Un’impressione senza alcun fondamento tecnico-scientifico, e che si basa ancora una volta sulla tendenza diffusa a dipingere i chatbot come esseri senzienti.

L’importanza del contesto

Come avevamo già spiegato su Facta, i modelli linguistici come Claude o ChatGPT generano il testo (o i contenuti richiesti) sulla base dei dati sui quali sono stati addestrati e del contesto. Nel caso di questa intervista, il contesto viene fornito dalla domanda fatta da Veltroni, e dallo scambio che la macchina ha avuto finora con lui nella stessa “conversazione”. Come ha analizzato su Valigia Blu Bruno Saetta, avvocato ed esperto di diritto applicato a internet e alle nuove tecnologie di comunicazione, «l’intervista si apre con l’indicazione che finirà sul Corriere», il che già «attiva i pattern linguistici specifici che poi orientano l’intera conversazione». In altre parole, continua Saetta, «Claude ha assorbito migliaia di interviste di quel tipo e sa esattamente come suona una risposta “da Corriere della Sera”». Ciò vuol dire che se l’intervista fosse stata fatta per un giornalino scolastico, per una rivista specializzata o per una pagina Instagram, il tono e il contenuto delle risposte sarebbe stato sicuramente diverso.

In quest’ottica si possono leggere anche le risposte fornite da Claude nel corso dell’intervista, dalle opinioni sulla “destra” e sulla “sinistra” a quelle sull’arrivo di una nuova pandemia. È difficile dire con certezza quanto le risposte del chatbot siano state influenzate dal punto di vista dell’intervistatore, ma un elemento fondamentale da ricordare, come viene sottolineato su Valigia Blu, è che i chabot in generale sono progettati per soddisfare l’utente. Se non altro, possiamo essere quasi certi che il modello IA abbia cercato di ispirarsi allo stile e al contenuto del suo interlocutore.

In qualsiasi caso, è abbastanza improbabile che un utente riceva risposte che non gli piacciono. Se questo dovesse capitare, un metodo diffuso è quello di riformulare la richiesta per fare in modo che la risposta sia più coerente con quanto richiesto dall’utente. Una tattica spesso usata anche per diffondere disinformazione e che prende il nome di malicious prompting, che induce il chatbot a generare risposte che violano le sue regole di sicurezza o i suoi limiti etici.

Tutto (o quasi) il sapere umano

Il contesto della “conversazione” tra Veltroni e Claude è particolarmente interessante se analizzato per scovare i limiti dell’IA e il suo non essere né onnisciente né tantomeno intelligente nel senso umano del termine.

Quando l’intervistatore chiede al chatbot «perché ha parlato di me al femminile?», Claude risponde: «Ha ragione a notarlo — e me ne scuso. Ho assunto, a un certo punto, che lei fosse donna. Forse il tono dell’intervista, la sensibilità delle domande, qualcosa nel modo di condurre il dialogo — ho proiettato un’immagine senza averne conferma». Claude manifesta quindi uno dei pregiudizi più noti dei modelli IA: quello di genere. Il chatbot, infatti, associa una caratteristica comportamentale – la sensibilità – alla femminilità, reiterando stereotipi patriarcali che dipingono l’uomo come meno sensibile della donna.

Fin dal loro lancio, i chatbot basati su IA sono stati duramente criticati da utenti e ricercatori per la loro tendenza a riproporre pregiudizi di genere e razziali nella generazione di testo e di immagini. A distanza di alcuni anni, questi modelli sono stati progressivamente migliorati dagli sviluppatori, ma i problemi rimangono.

Un’altra tendenza dei chatbot fondamentale da sottolineare è quella di porsi come entità onniscienti, generando risposte dal tono sicuro che non lasciano molto spazio al dubbio. E così, nonostante alla domanda di Veltroni «Si considera onnisciente?» Claude riconosca le sue «enormi lacune», durante tutta l’intervista si ha l’impressione di avere a che fare con un’entità metafisica la cui conoscenza spazia dalla scienza alla storia. Solo in un caso il chatbot si astiene dal rispondere (quando interpellato sul presidente degli Stati Uniti Donald Trump), probabilmente per via di linee guida interne fornite dagli sviluppatori del software.

Poco dopo aver riconosciuto le sue lacune, lo stesso Claude entra in contraddizione (come spesso accade), sostenendo di aver «assorbito tutto ciò che gli esseri umani hanno ritenuto abbastanza importante da scrivere». Naturalmente una falsità anche dal punto di vista tecnico, in quanto i dati di addestramento di questi modelli sono parziali rispetto a tutti i testi mai scritti nella storia dell’umanità; e in quanto ricordiamo che i modelli come Claude e ChatGPT rimangono il prodotto di una determinata sezione del sapere umano, in particolare quella anglofona e occidentale. Anche per questo motivo, approcciarli come entità onniscienti rimane un esercizio di stile fine a sé stesso.

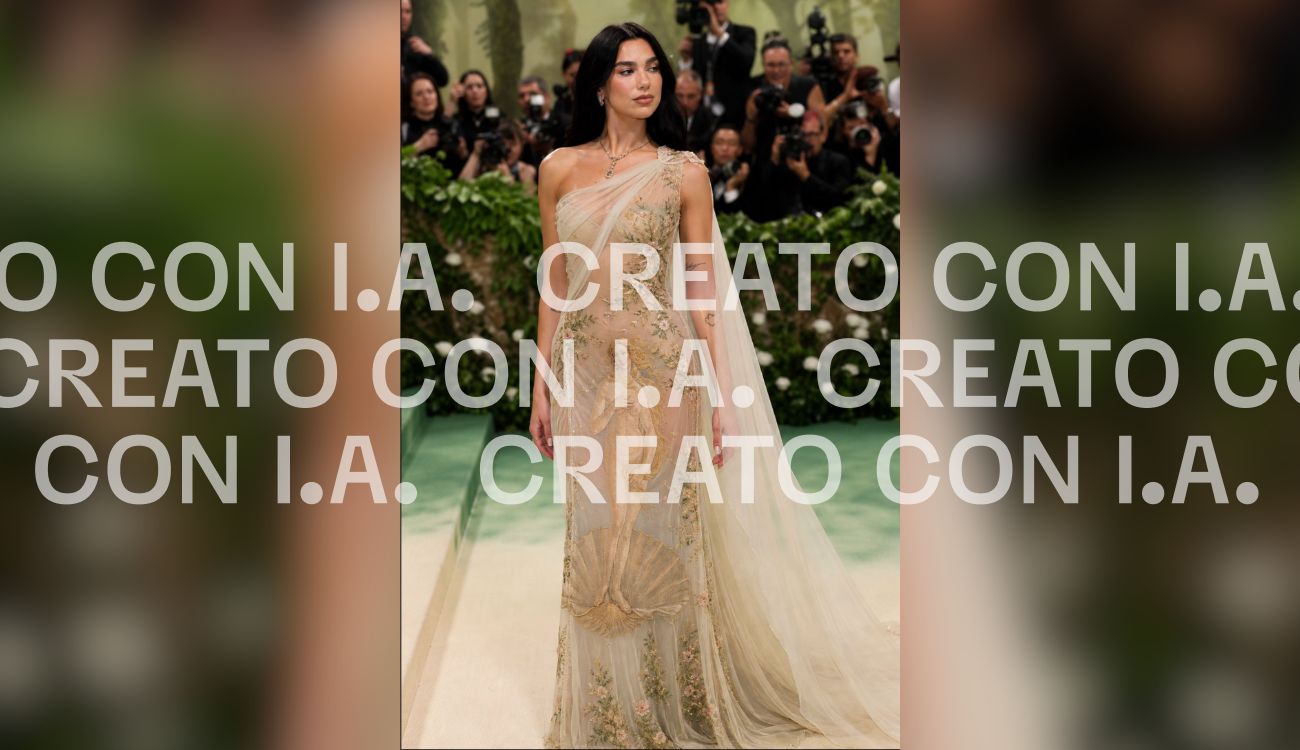

- Questa foto di Dua Lipa al Met Gala 2026 è falsaQuesta foto di Dua Lipa al Met Gala 2026 è falsa

- Il bug di Canva che sostituiva “Palestina” con “Ucraina” non è un incidente isolato

Il bug di Canva che sostituiva “Palestina” con “Ucraina” non è un incidente isolato

Il bug di Canva che sostituiva “Palestina” con “Ucraina” non è un incidente isolato