La paranoia da intelligenza artificiale che ha generato le voci infondate sulla morte di Benjamin Netanyahu

Sui social media, video autentici del premier israeliano sono stati infondatamente accusati di essere contenuti artificiali usati per ingannare l’opinione pubblica internazionale

Da quando lo scorso 28 febbraio è iniziata la nuova guerra in Medio Oriente si è subito registrata sui social media una valanga di falsificazioni generate con l’ausilio dell’intelligenza artificiale che hanno scatenato caos online e disinformazione, ha scritto il New York Times. Una tale mole di video e immagini artificiali (divenuti sempre più precisi e realistici) non si era mai registrata durante i primi giorni dei precedenti conflitti. Tutto ciò ha finito inesorabilmente per creare una specie di paranoia collettiva sui contenuti che circolano online, spesso alimentata da teorici della cospirazione o propagandisti. Il risultato è che nessun contenuto visivo è ormai immune dal sospetto che sia un falso generato con IA.

Quello che è successo in questi giorni sui social media di diversi Paesi con un video reale di Benjamin Netanyahu, accusato da svariati utenti di essere un prodotto dell’intelligenza artificiale utilizzato da Israele per nascondere all’opinione pubblica internazionale la presunta notizia della sua morte, è un esempio lampante di questa dinamica.

Tutto è iniziato giovedì 12 marzo 2026, quando il governo israealiano ha pubblicato sul proprio account ufficiale di YouTube il video della conferenza stampa in cui il primo ministro israeliano ha parlato del conflitto in Medio Oriente e degli attacchi dell’esercito israeliano all’Iran e in Libano. È stato il primo discorso alla nazione di Netanyahu dall’attacco congiunto contro Teheran avviato con gli Stati Uniti a fine febbraio 2026.

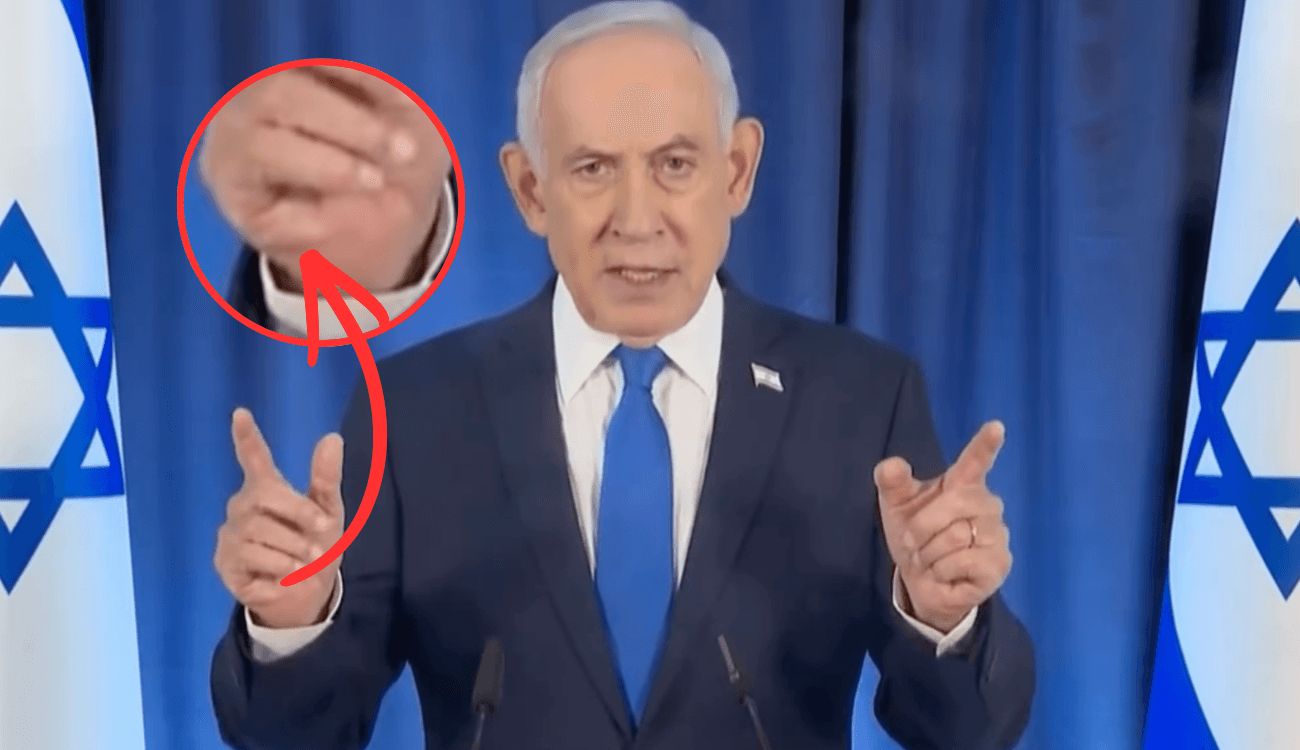

Subito dopo la diffusione del filmato, svariati account social hanno iniziato a diffondere fotogrammi per sostenere che il video della conferenza fosse un falso generato con l’intelligenza artificiale, generando milioni di visualizzazioni. Le prove sarebbero state alcune incongruenze tipiche dell’IA presenti in queste immagini. Secondo la più citata, una delle mani del primo ministro israeliano appare con sei dita. Questo contenuto è stato rilanciato anche dall’account Instagram @eye.on.palestine, con 13,5 milioni di follower, che prima ha ripubblicato la presunta notizia per poi rimuoverla, ha ricostruito il sito di fact-checking statunitense Snopes.

Secondo chi sostiene questa tesi, dietro la condivisione maldestra da parte del governo israliano di un simile video chiaramente IA ci sarebbe stata la volontà di nascondere una notizia molto più importante: il ferimento o addirittura la morte di Benjamin Netanyahu in seguito a un attacco di Teheran. In quegli stessi giorni era circolato in Rete il video di un’abitazione in fiamme, presentata come la casa di Netanyahu in Israele colpita da un drone iraniano.

Tutta questa teoria speculativa, tuttavia, è priva di qualsiasi riscontro o prova. Come abbiamo ricostruito a Facta, la casa in fiamme è in realtà una villa al 629 di Park Place a Galloway Township, in New Jersey, andata a fuoco l’8 febbraio scorso. Nessuna testata credibile e affidabile ha dato la notizia che l’abitazione di Benjamin Netanyahu sarebbe stata colpita dall’Iran o che il premier israliano sarebbe stato ucciso o ferito. Anche la notizia dell’arresto da parte di Israele di un giornalista indiano che avrebbe mostrato la casa distrutta del premier israeliano è del tutto inventata.

È priva di qualsiasi fondamento anche l’affermazione secondo cui il video della conferenza stampa del primo ministro israeliano sarebbe falso generato con l’IA. Le prove che citano presunte incongruenze tipiche dei video IA sono tutte infondate. Guardando l’intera conferenza non c’è alcuna traccia delle presunte sei dita o di altri errori. Come si vede analizzando nel dettaglio il fermo immagine del dettaglio (al minuto 01:49 di questo video), le dita sono sempre cinque. Il “sesto dito” indicato da chi ha diffuso la falsa notizia è in realtà il palmo della mano di Netanyahu.

Per smentire le dicerie sulla sua morte, il 15 marzo lo stesso Benjamin Netanyahu ha pubblicato un video sulle sue pagine social ufficiali mentre sorseggia sorridente un caffè dentro un bar. Nel filmato, il premier israeliano ironizza anche sulle sue dita, mostrando verso la telecamera che lo riprende le sue due mani, ognuna con cinque dita. Ma anche questo stesso filmato è finito in poco tempo in altre teorie del complotto: secondo alcuni si tratterebbe di una vecchia clip, per altri anche in questo caso ci sarebbero elementi non realistici che suggerirebbero la natura artificiale del video. Un’altra menzogna, dunque, secondo diversi utenti, per nascondere la verità sulle reali condizioni di salute del premier israeliano.

Non esistono tuttavia segnali che indichino che la scena sia stata creata artificialmente. L’account Instagram del locale mostrato nel video di di Netanyahu – chiamato “The Sataf” e situato a Gerusalemme – ha pubblicato il 15 marzo 2026 diverse foto che confermano la visita del primo ministro. Reuters ha inoltre verificato la posizione del video in questione tramite immagini d’archivio del locale, che corrispondono agli interni mostrati nel filmato.

Ad alimentare queste teorie cospirative e ulteriore confusione ha contribuito (ancora una volta) anche Grok, l’intelligenza artificiale di X, che alle domande degli utenti se i filmati pubblicati dal governo e dal premier israeliani fossero reali ha risposto che entrambi erano stati generati con l’intelligenza artificiale.

Riconoscere video IA sta diventando sempre più difficile, per questo a Facta abbiamo pubblicato recentemente una guida con i metodi più efficaci che chiunque può mettere in pratica per identificarli e non lasciarsi ingannare.

- Il bug di Canva che sostituiva “Palestina” con “Ucraina” non è un incidente isolato

Il bug di Canva che sostituiva “Palestina” con “Ucraina” non è un incidente isolato

Il bug di Canva che sostituiva “Palestina” con “Ucraina” non è un incidente isolato - Bixonimania, la malattia inventata che per due anni ha ingannato i chatbot AI

Bixonimania, la malattia inventata che per due anni ha ingannato i chatbot AI

Bixonimania, la malattia inventata che per due anni ha ingannato i chatbot AI